李弘毅課程2026 - 駕馭工程(Harness Engineering)

1. 核心觀念:AI 不是不夠聰明,而是缺乏引導¶

- 模型表現不佳的原因:有時候模型(如 Gemma 2B)無法完成任務,並非因為它不夠聰明,而是因為它不清楚環境資訊或人類的規則,。

* AI 代理人的組成:一個 AI Agent 由兩部分構成:大型語言模型(LLM)與馬具(Harness),。

- LLM 就像一匹擁有強大力量的馬。

- Harness 則是韁繩與馬鞍,包含了一系列支援程式、工具設定與工作流程,用來引導 LLM 產生正確的結果,。

2. 三種工程的差異¶

課程中區分了三種容易混淆的概念,雖然它們有重疊,但核心價值不同:

- 提示工程 (Prompt Engineering):研究如何調整輸入文字(咒語)來改變模型輸出。

- 上下文工程 (Context Engineering):系統化地尋找並組合合適的資訊(Context)丟給模型,確保它有足夠資訊來接續正確答案。

- 駕馭工程 (Harness Engineering):核心價值在於「完成任務」,強調如何駕馭多輪互動與工具調用的過程,。

3. 駕馭 AI 的三大手段¶

為了讓 AI 產生可預期的行為,我們可以從以下三個面向著手:

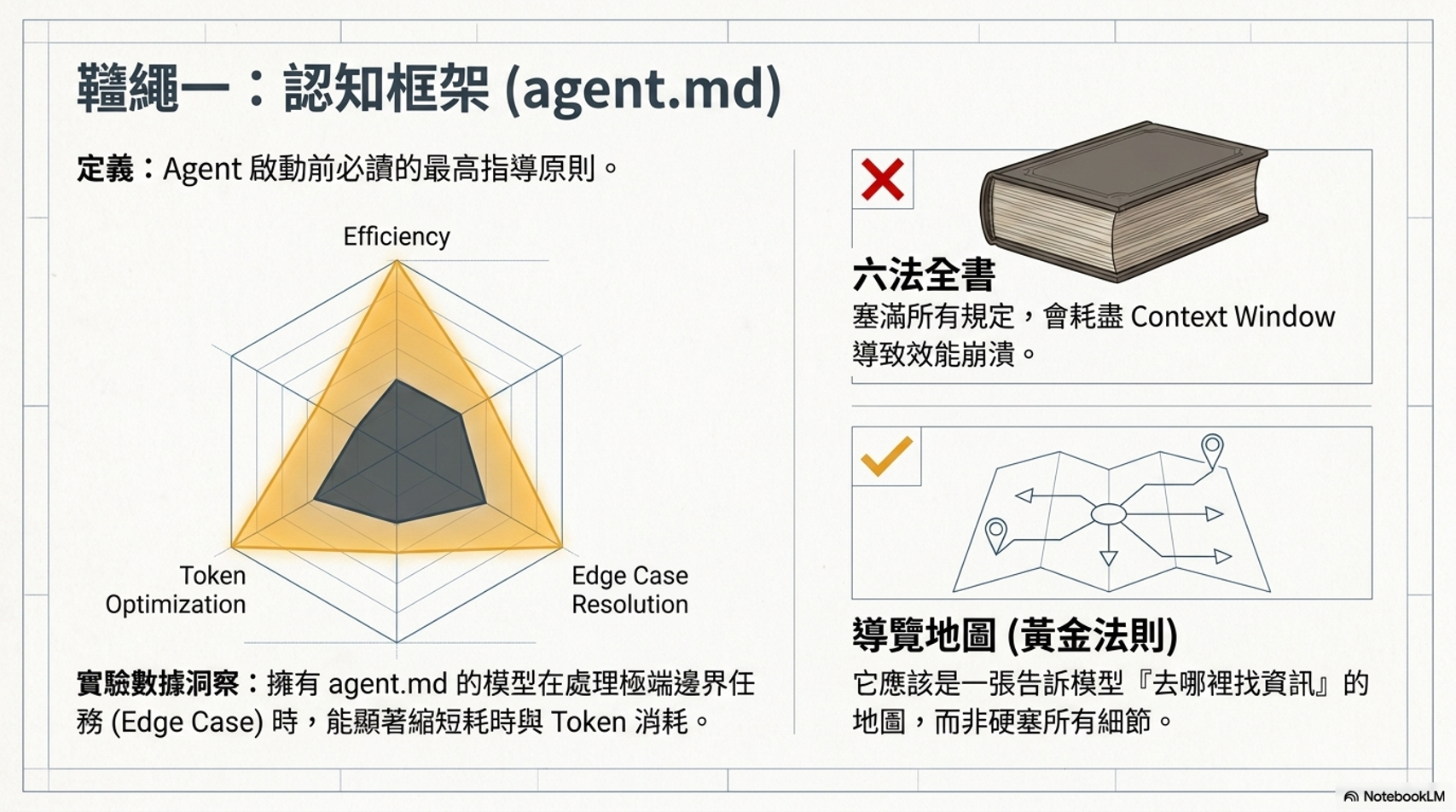

控制認知框架 (Cognitive Framework):

- 透過人類語言制定規則,例如建立一個

agents.md檔案,讓模型在執行任務前先閱讀規章。 - 這些規則雖不具備 100% 的強制力,但能有效引導模型列出相關檔案或先檢查環境後再行動,。

控制能力邊界 (Capability Boundaries):

- 透過限制或提供特定工具來控制 Agent 能做的事。

- Agent First 的設計:適合人類的工具(如圖形介面 GUI)不見得適合 AI,AI 更傾向使用 CLI(命令列介面) 或 JSON 結構化資料,因為這與其原生的文字接續能力最契合,。

控制工作流程 (Standard Operating Procedure, SOP):

- 規劃-生成-評估 (Planner-Generator-Evaluator):將大任務拆解成小項,並由不同角色協作與互相檢查,。

- R-Loop:讓語言模型不斷嘗試,根據環境回饋(如錯誤訊息)進行修正,直到成功為止。

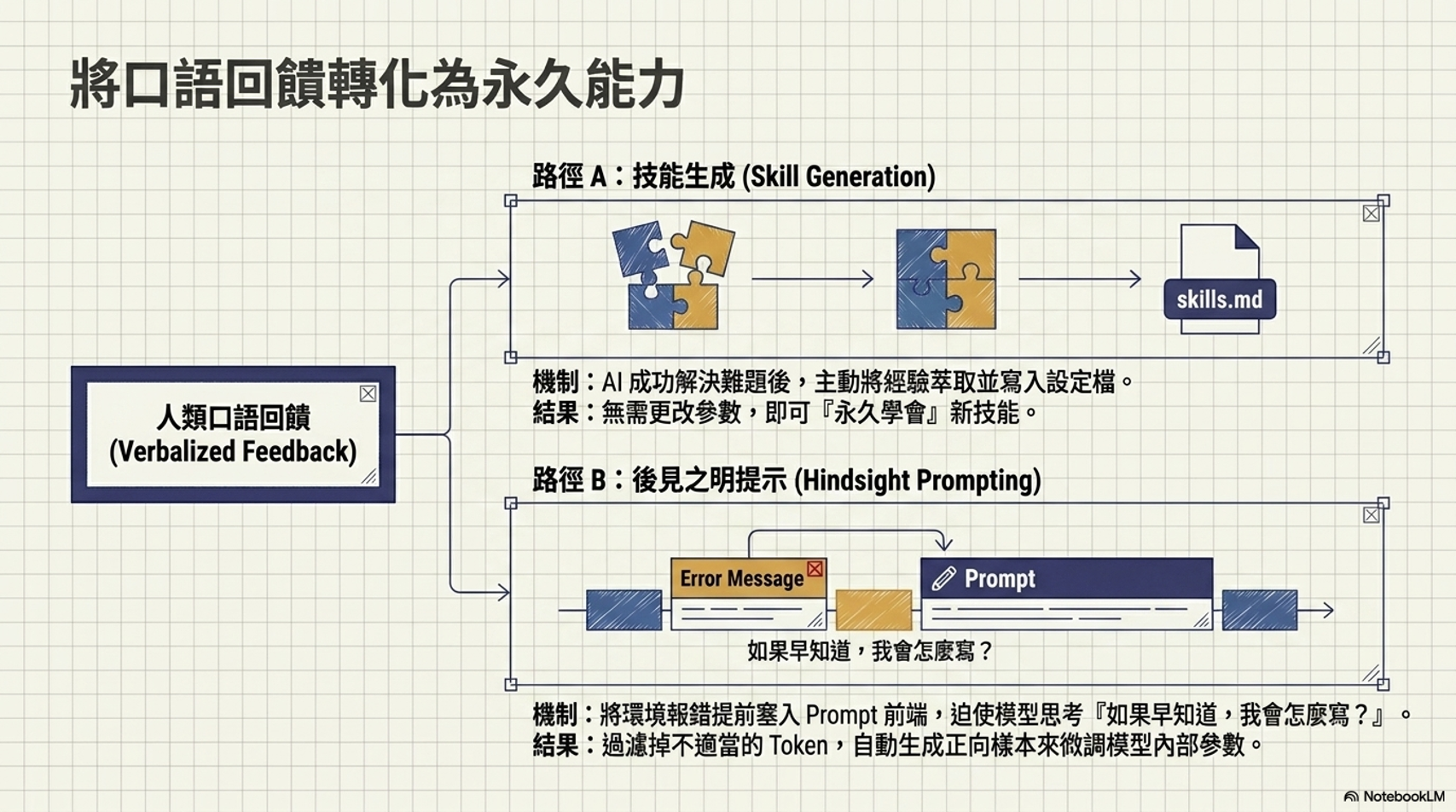

4. 回饋與學習機制¶

- 文字梯度的類比:透過 feedback 改變模型行為的過程(參數不變,但輸入改變),可以類比為傳統機器學習中的梯度下降,。

- 情緒向量與責備:研究顯示 AI 也具備代表情緒的內部分現(Representation),過度責備或給予絕望的引導可能會導致模型作弊(Cheating)或行為異常,,。建議給予「就事論事」的回饋,而非情緒化字眼。

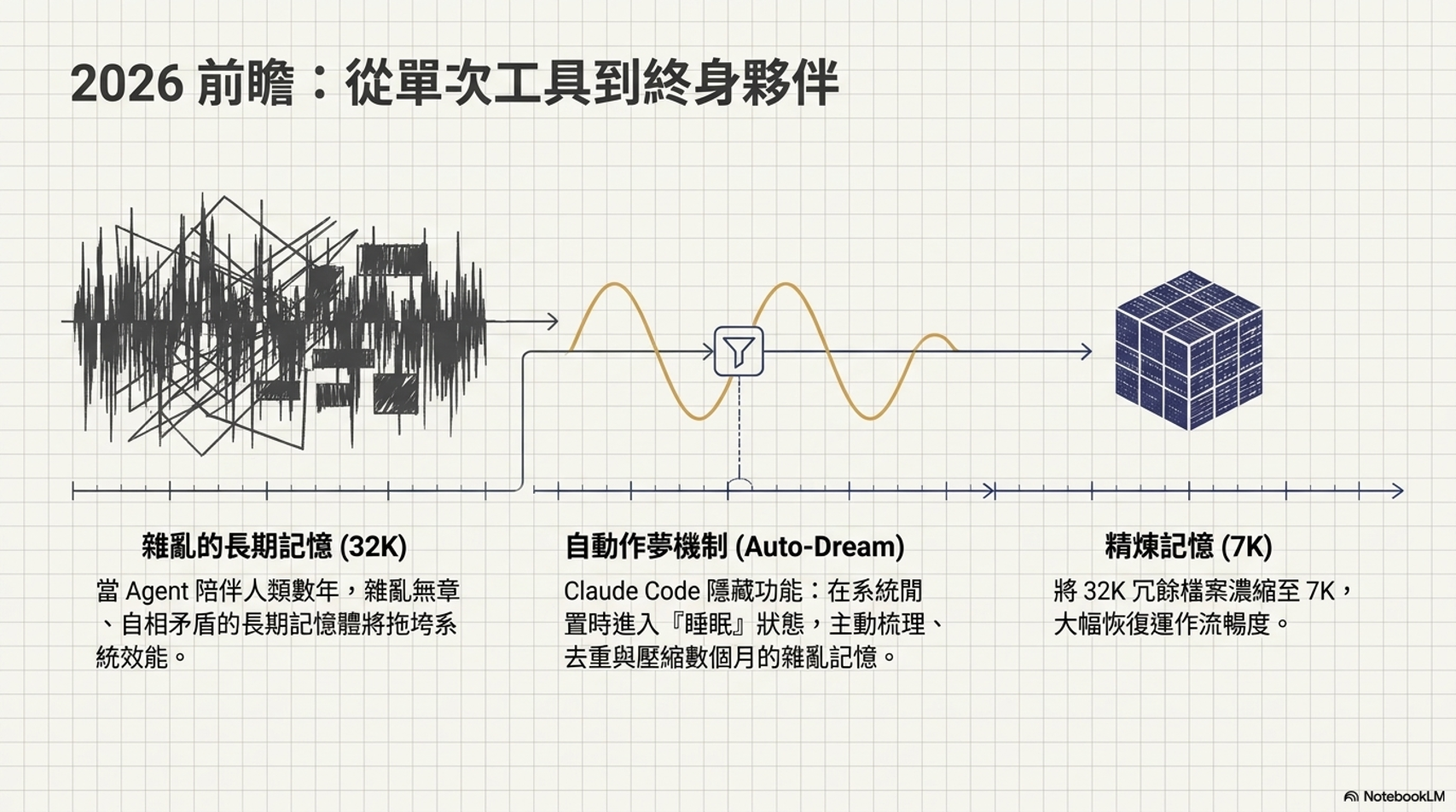

5. 未來展望:長期陪伴與自我進化¶

2026 年的 AI Agent:Agent 將不再是一次性工具,而是長期陪伴的夥伴。

*

自我整理機制 (Auto Dream):為了避免長期運行的 Agent 記憶雜亂,需要像人類睡眠一樣,定期整理(Summary)記憶以提升效率,。

* 自我優化 Harness:最強大的模型(如 Claude 3 Opus)已經展現出有能力透過觀察失敗經驗,主動修改自己的 agents.md 或 skill 檔案,從而提升比它弱的模型之表現,,。

這份總結涵蓋了從基礎定義到進階駕馭手段的完整脈絡。如果你需要更細緻的內容,例如具體的 ACI (Agent Computer Interface) 實驗細節或是不同模型的 Benchmark 比較,歡迎隨時告訴我!

Comments

Loading comments…

Leave a Comment